NVIDIA DGX SuperPOD ebnet den Weg für groß angelegte Systembereitstellungen auf Basis der NVIDIA Rubin-Plattform – dem nächsten großen Fortschritt im Bereich des KI-Computings.

Auf der CES in Las Vegas stellte NVIDIA die Rubin-Plattform vor, die sechs neue Chips umfasst, die einen beeindruckenden KI-Supercomputer bilden und speziell für die Beschleunigung von agentenbasierter KI, Mixture-of-Experts-Modellen (MoE) und Long-Context-Reasoning entwickelt wurden.

Die Rubin-Plattform vereint sechs Chips – die NVIDIA Vera-CPU, Rubin-GPU, NVLink 6 Switch, ConnectX-9 SuperNIC, BlueField-4 DPU und Spectrum-6 Ethernet Switch – durch einen fortschrittlichen Codesign-Ansatz, der das Training beschleunigt und die Kosten für die Generierung von Inferenz-Token reduziert.

DGX SuperPOD ist nach wie vor das grundlegende Design für die Bereitstellung von Rubin-basierten Systemen in Unternehmens- und Forschungsumgebungen.

Die NVIDIA DGX-Plattform deckt den gesamten Technologie-Stack ab – vom NVIDIA Computing über das Netzwerk bis hin zur Software – als ein einziges, zusammenhängendes System, wodurch die Integration der Infrastruktur entlastet wird und Teams sich auf KI-Innovationen und Geschäftsergebnisse konzentrieren können.

„Rubin kommt genau zum richtigen Zeitpunkt, da die Nachfrage nach KI-Computing sowohl für das Training als auch für die Inferenz enorm steigt“, erklärt Jensen Huang, Gründer und CEO von NVIDIA.

Neue Plattform für die industrielle KI-Revolution

Die Rubin-Plattform, die in den neuen DGX-Systemen verwendet wird, bietet fünf wichtige technologische Fortschritte, die eine deutliche Steigerung der Intelligenz und Effizienz ermöglichen:

- NVIDIA NVLink der sechsten Generation – 3,6 TB/s pro GPU und 260 TB/s pro Vera Rubin NVL72 Rack für massive MoE-Workloads und langes Kontext-Schlussfolgern.

- NVIDIA Vera CPU – 88 spezifische NVIDIA Olympus-Kerne, vollständige Armv9.2-Kompatibilität und ultraschnelle NVLink-C2C-Konnektivität für branchenführende und effiziente KI-Fabrik-Rechenleistung.

- NVIDIA Rubin GPU – 50 Petaflops NVFP4 Rechenleistung für KI-Inferenz mit einer Transformer-Engine der dritten Generation mit hardwarebeschleunigter Komprimierung.

- NVIDIA Confidential Computing der dritten Generation – Vera Rubin NVL72 ist die erste Rack-Scale-Plattform, die NVIDIA Confidential Computing bietet, um die Datensicherheit über CPU-, GPU- und NVLink-Domänen hinweg zu gewährleisten.

- RAS-Engine der zweiten Generation – Die NVIDIA Rubin-Plattform umfasst GPU, CPU und NVLink und bietet Echtzeit-Zustandsüberwachung, Fehlertoleranz und proaktive Wartung. Modulare kabelfreie Trays ermöglichen eine dreimal schnellere Wartung.

Zusammen ermöglichen diese Innovationen eine bis zu zehnfache Reduzierung der Kosten für Inferenz-Token im Vergleich zur Vorgängergeneration – ein entscheidender Meilenstein, da KI-Modelle an Größe, Kontext und logischer Tiefe zunehmen.

DGX SuperPOD: Der Blueprint für NVIDIA Rubin Scale-Out

Auf Rubin basierende DGX SuperPOD-Bereitstellungen umfassen Folgendes:

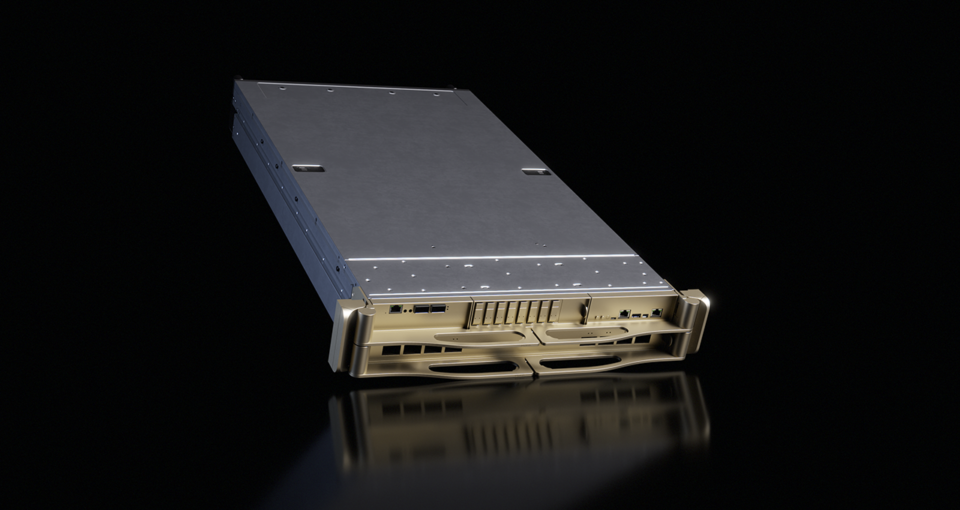

- NVIDIA DGX Vera Rubin NVL72– oder DGX Rubin NVL8-Systeme

- NVIDIA BlueField-4 DPUs für eine sichere, softwaredefinierte Infrastruktur

- NVIDIA Inference Context Memory Datenspeicher-Plattform für Inferenz der nächsten Generation

- NVIDIA ConnectX-9 SuperNICs

- NVIDIA Quantum-X800 InfiniBand und NVIDIA Spectrum-X Ethernet

- NVIDIA Mission Control für die automatisierte Orchestrierung und den Betrieb einer KI-Infrastruktur

NVIDIA DGX SuperPOD mit DGX Vera Rubin NVL72 verbindet acht DGX Vera Rubin NVL72-Systeme mit 576 Rubin-GPUs und bietet 28,8 Exaflops FP4-Leistung und 600 TB schnellen Speicher. Jedes DGX Vera Rubin NVL72-System, das 36 Vera-CPUs, 72 Rubin-GPUs und 18 BlueField-4 DPUs kombiniert, ermöglicht einen einheitlichen Speicher- und Rechenplatz über das gesamte Rack. Mit einem NVLink-Gesamtdurchsatz von 260 TB/s ist die Modellpartitionierung überflüssig und ermöglicht den Betrieb des gesamten Racks als eine einzige kohärente KI-Engine.

NVIDIA DGX SuperPOD mit DGX Rubin NVL8-Systemen bietet 64 DGX Rubin NVL8-Systeme mit 512 Rubin-GPUs. NVIDIA DGX Rubin NVL8-Systeme bringen die Leistung von Rubin mit x86-CPUs in einen flüssigkeitsgekühlten Formfaktor und ermöglichen Unternehmen so einen effizienten Einstieg in die Rubin-Ära für jedes KI-Projekt in der Entwicklungs- und Bereitstellungspipeline. Jeder DGX Rubin NVL8 wird von acht NVIDIA Rubin-GPUs und NVLink der sechsten Generation angetrieben und bietet im Vergleich zu NVIDIA Blackwell-Systemen 5,5-mal so viele NVFP4 FLOPS.

Netzwerk der nächsten Generation für KI-Fabriken

Die Rubin-Plattform definiert das Rechenzentrum als leistungsstarke KI-Fabrik mit revolutionärem Netzwerk aus NVIDIA Spectrum-6 Ethernet-Switches, NVIDIA Quantum-X800 InfiniBand-Switches, BlueField-4 DPUs und ConnectX-9 SuperNICs neu, die die weltweit größten KI-Workloads bewältigen können. Durch die Integration dieser Innovationen in NVIDIA DGX SuperPOD beseitigt die Rubin-Plattform die herkömmlichen Engpässe in den Bereichen Skalierung, Überlastung und Zuverlässigkeit.

Optimierte Konnektivität für Cluster in großem Umfang

Die 800-Gbit/s-Netzwerksuite der nächsten Generation bietet zwei speziell entwickelte Wege für die KI-Infrastruktur und sorgt für maximale Effizienz bei Verwendung von InfiniBand oder Ethernet:

- NVIDIA Quantum-X800 InfiniBand: Bietet die branchenweit niedrigste Latenz und höchste Leistung für dedizierte KI-Cluster. Es nutzt das skalierbare Hierarchical Aggregation and Reduction Protocol (SHARP v4) und adaptives Routing, um kollektive Vorgänge in das Netzwerk zu verlagern.

- NVIDIA Spectrum-X Ethernet: Diese Plattform basiert auf dem Spectrum-6 Ethernet-Switch und ConnectX-9 SuperNIC und bietet vorhersehbare, leistungsstarke Scale-out- und Scale-across-Konnektivität für KI-Fabriken mit Standard-Ethernet-Protokollen, die speziell für die „East-West“-Datenverkehrsmuster von KI-Workloads optimiert sind.

Entwicklung der Gigawatt-KI-Fabrik

Diese Innovationen stellen ein extremes Codesign mit der Rubin-Plattform dar. Durch die Beherrschung der Überlastungssteuerung und Leistungsisolierung ebnet NVIDIA den Weg für die nächste Generation von KI-Fabriken im Gigawatt-Bereich. Dieser ganzheitliche Ansatz stellt sicher, dass die Netzwerkstruktur der KI-Fabrik bei zunehmender Komplexität der KI-Modelle ein Katalysator für Geschwindigkeit und keine Einschränkung darstellt.

NVIDIA Software verbessert den Betrieb und die Bereitstellung von KI-Fabriken.

NVIDIA Mission Control – eine Software zur Betriebs- und Orchestrierung von KI-Rechenzentren für NVIDIA Blackwell-basierte DGX-Systeme – wird für Rubin-basierte NVIDIA DGX-Systeme verfügbar sein, um Unternehmen die Verwaltung und den Betrieb ihrer Infrastruktur zu automatisieren.

NVIDIA Mission Control beschleunigt alle Aspekte des Infrastrukturbetriebs, von der Konfiguration der Bereitstellung über die Integration in Einrichtungen bis hin zur Verwaltung von Clustern und Workloads.

Mit intelligenter, integrierter Software erhalten Unternehmen eine bessere Kontrolle über Kühlungs- und Energieversorgungsvorgänge für NVIDIA Rubin sowie die Ausfallsicherheit der Infrastruktur. NVIDIA Mission Control ermöglicht eine schnellere Reaktion durch schnelle Leckageerkennung, ermöglicht den Zugriff auf die neuesten Effizienzinnovationen von NVIDIA und maximiert die Produktivität der KI-Fabrik durch autonome Wiederherstellung.

NVIDIA DGX-Systeme unterstützen außerdem die NVIDIA AI Enterprise-Softwareplattform, einschließlich NVIDIA NIM-Microservices, wie z. B. die NVIDIA Nemotron-3-Familie offener Modelle, Daten und Bibliotheken.

DGX SuperPOD: Der Weg in die Zukunft für industrielle KI.

DGX SuperPOD dient seit langem als Vorlage für eine groß angelegte KI-Infrastruktur. Die Einführung der Rubin-Plattform wird die Startrampe für eine neue Generation von KI-Fabriken sein – Systeme, die über tausende von Schritten logische Schlussfolgerungen ziehen und Intelligenz zu deutlich geringeren Kosten liefern, wodurch Unternehmen bei der Entwicklung der nächsten Generation von Grenzmodellen, multimodalen Systemen und agentischen KI-Anwendungen unterstützt werden.

NVIDIA DGX SuperPOD mit DGX Vera Rubin NVL72- oder DGX Rubin NVL8-Systemen wird in der zweiten Hälfte dieses Jahres verfügbar sein.

Siehe Hinweise zu Softwareproduktinformationen.