NVIDIA-Gründer und CEO Jensen Huang ist heute im Fontainebleau Las Vegas auf die Bühne gegangen, um die CES 2026 zu eröffnen, und erklärte, dass KI in alle Bereiche und Geräte vordringen wird.

„Das gesamte Computing ist durch beschleunigtes Rechnen und durch Künstliche Intelligenz grundlegend verändert worden“, sagte Huang. „Das bedeutet, dass Rechnerleistungen im Wert von rund 10 Billionen US‑Dollar aus dem vergangenen Jahrzehnt nun auf diese neue Art des Computings modernisiert werden.“

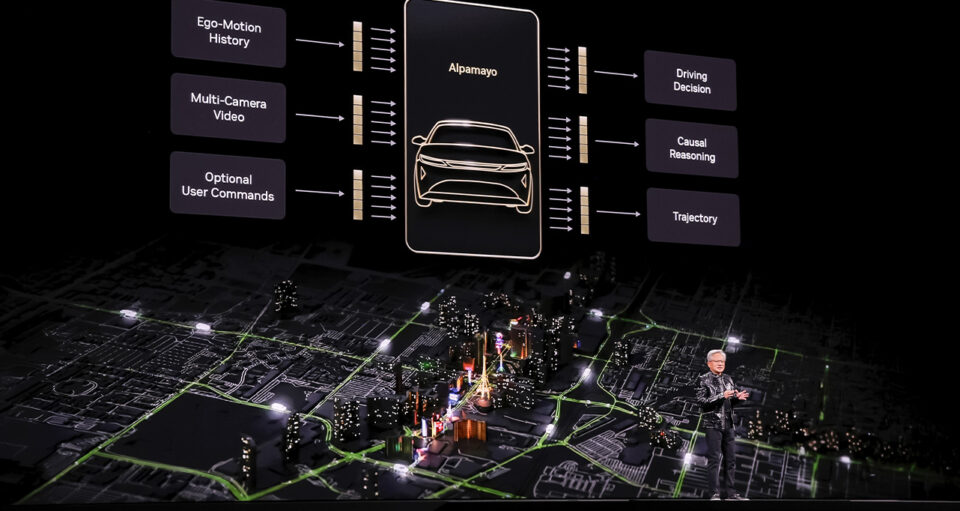

Huang stellte Rubin vor, NVIDIAs erste extrem co-designte KI-Plattform mit sechs Chips, die nun vollständig in Produktion ist, und präsentierte Alpamayo, eine offene Reasoning-Modellfamilie für die Entwicklung autonomer Fahrzeuge – Teil einer umfassenden Initiative, KI in alle Bereiche zu bringen.

Mit Rubin will NVIDIA „KI auf die nächste Stufe bringen“, während die Kosten für das Generieren von Token auf etwa ein Zehntel der vorherigen Plattform gesenkt werden, sagte Huang, was KI im großen Maßstab weitaus kosteneffektiver macht.

Huang betonte auch die Rolle der offenen Modelle von NVIDIA in allen Bereichen, trainiert auf NVIDIA-Supercomputern und formt so ein globales Ökosystem aus Intelligenz, auf dem Entwickler und Unternehmen bauen können.

„Alle sechs Monate kommt ein neues Modell auf den Markt, und diese Modelle werden immer intelligenter“, sagte Huang. „Daher ist die Anzahl der Downloads explodiert.“

Alle NVIDIA-Meldungen von der CES finden Sie in diesem Online-Pressekit.

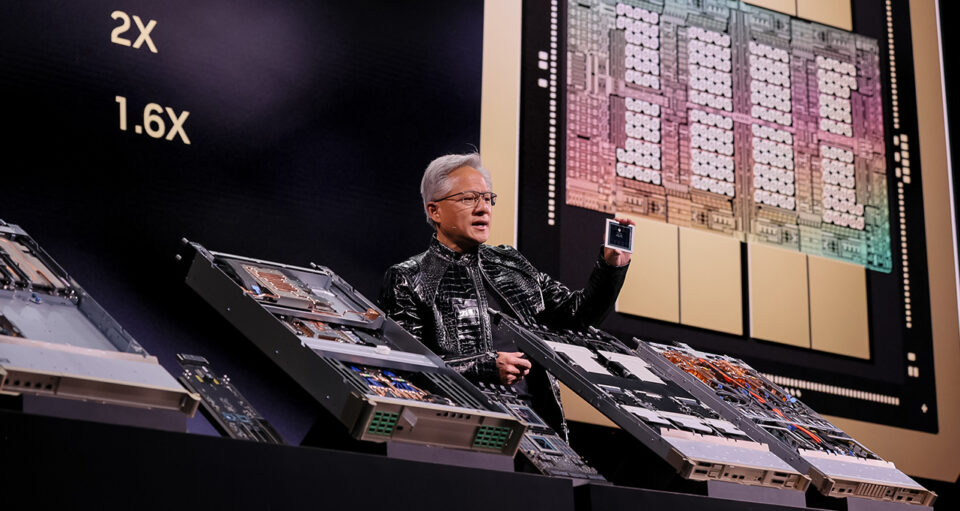

Ein neuer Motor für Intelligenz: Die Rubin-Plattform

Nachdem Huang das Publikum mit der amerikanischen Pionierastronomin Vera Rubin, nach der NVIDIA seine nächste Computing-Plattform benannt hat, bekannt gemacht hatte, kündigte er an, dass die NVIDIA Rubin-Plattform – Nachfolgerin der rekordverdächtigen Architektur NVIDIA Blackwell und die erste extrem co-designte KI-Plattform mit sechs Chips von NVIDIA – nun in vollem Umfang produziert wird.

Die Komponenten der Rubin-Plattform werden vom Rechenzentrum aus entwickelt und umfassen:

- Rubin-GPUs mit 50 Petaflops an NVFP4-Inferenz

- Vera-CPUs, die für Datenbewegung und agentenbasierte Verarbeitung konzipiert wurden

- NVLink 6 – Skalierung der Netzwerkverbindungen

- Spectrum-X-Ethernet-Photonics – Skalierung der Netzwerkverbindungen

- ConnectX‑9 SuperNICs

- BlueField‑4 DPUs

Extremes Codesign – das Design all dieser Komponenten gemeinsam – ist unerlässlich, da die Skalierung von KI auf Gigabit-Basis enge integrierte Innovationen über Chips, Trays, Racks, Netzwerke, Speicher und Software erfordert, um Engpässe zu beseitigen und die Kosten für Training und Inferenz drastisch zu senken“, erklärte Huang.

Er stellte auch KI-native Speicherung mit der NVIDIA Inference Context Memory Storage Platform vor – eine KI-native KV-Cache-Ebene, die lange Kontext-Inferenzen mit 5-mal höheren Tokens pro Sekunde beschleunigt sowie eine 5-mal bessere Leistung pro TCO-Dollar bietet und eine 5-mal bessere Energieeffizienz aufweist.

Wenn man alles zusammenfasst, verspricht die Rubin-Plattform, KI-Innovationen drastisch zu beschleunigen und KI-Token zu einem Zehntel der Kosten bereitzustellen. „Je schneller man KI-Modelle trainiert, desto schneller kann man den nächsten Durchbruch erzielen“, sagte Huang. „Das ist Ihre Markteinführungsgeschwindigkeit. Das ist Technologieführerschaft.“

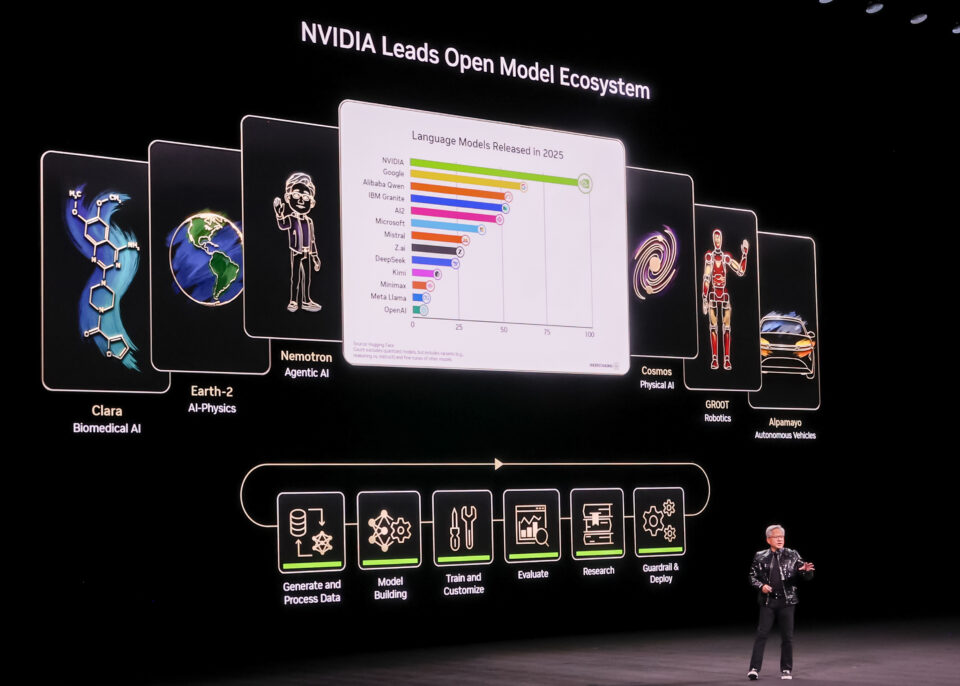

Offene Modelle für alle

NVIDIAs offene Modelle – die auf den unternehmenseigenen Supercomputern trainiert werden – ermöglichen Fortschritte in den Bereichen Gesundheitswesen, Klimawissenschaften, Robotik, verkörperte Intelligenz und autonomes Fahren.

„Jetzt sind wir auf Basis dieser Plattform ein Pionier KI-Modelbuilder, und wir entwickeln diese Modelle auf eine ganz besondere Weise. Wir entwickeln sie vollständig offen, sodass jedes Unternehmen, jede Branche und jedes Land Teil dieser KI-Revolution sein kann.“

Das Portfolio umfasst sechs Bereiche: Clara für das Gesundheitswesen, Earth-2 für die Klimawissenschaft, Nemotron für Reasoning und multimodale KI, Cosmos für Robotik und Simulation, GR00T für verkörperte Intelligenz und Alpamayo für autonomes Fahren – und bildet damit ein Fundament für Innovation in zahlreichen Branchen.

„Diese Modelle stehen der ganzen Welt offen“, sagte Huang und unterstrich NVIDIAs Rolle als KI-Pionier mit Weltklassemodellen, die Spitzenplätze in Benchmark-Ranglisten belegen. „Sie können das Modell erstellen, evaluieren, mit Guardrails versehen und bereitstellen.“

KI an jedem Schreibtisch: RTX, DGX Spark und persönliche Assistenten

Huang betonte, dass die Zukunft der KI nicht nur über Supercomputer geht – sie ist persönlich.

Huang zeigte eine Demo mit einem personalisierten KI-Agenten, der lokal auf dem NVIDIA DGX Spark Desktop-Supercomputer lief und über einen Reachy-Mini-Roboter mit Hugging-Face-Modellen verkörpert wurde – ein Beispiel dafür, wie offene Modelle, Model-Routing und lokale Ausführung Agenten in reaktionsfähige, physische Kollaborateure verwandeln.

„Das Erstaunliche ist, dass das jetzt völlig trivial ist, aber noch vor ein paar Jahren wäre das unmöglich gewesen, absolut unvorstellbar“, sagte Huang.

Die weltweit führenden Unternehmen integrieren NVIDIA-KI in ihre Produkte, sagte Huang und nannte Unternehmen wie Palantir, ServiceNow, Snowflake, CodeRabbit, CrowdStrike, NetApp und Semantec.

„Ob es sich um Palantir oder ServiceNow oder Snowflake handelt – und viele andere Unternehmen, mit denen wir zusammenarbeiten – das agentische System ist die Schnittstelle.“

Auf der CES gab NVIDIA zudem bekannt, dass DGX Spark bei großen Modellen eine bis zu 2,6-fache Leistung bietet. Neu hinzugekommen sind die Unterstützung für die Bildmodelle von Lightricks LTX-2 und FLUX sowie die bevorstehende Verfügbarkeit von NVIDIA AI Enterprise.

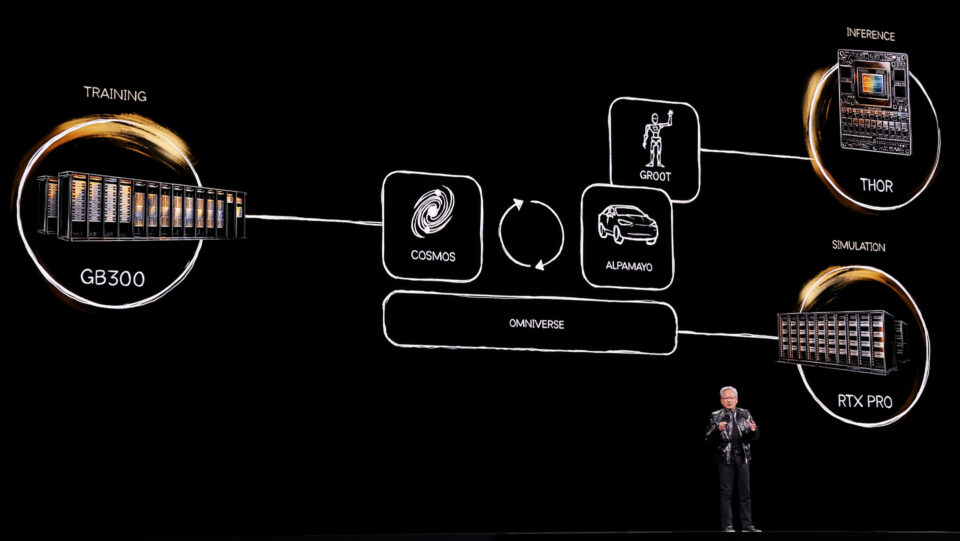

Physikalische KI

KI basiert nun auf der physischen Welt, und zwar durch NVIDIA-Technologien für Training, Inferenz und Edge-Computing.

Diese Systeme können lange vor dem Eingreifen in die reale Welt in virtuellen Welten mit synthetischen Daten trainiert werden.

Huang präsentierte NVIDIA Cosmos, offene World-Foundation-Modelle, die auf Videos, Robotikdaten und Simulationen trainiert sind und unter anderem

- realistische Videos aus Einzelbildern erzeugen,

- komplexe Fahrszenarien mit mehreren Kameras synthetisieren,

- Randfälle modellieren,

- physikalisches Reasoning mit Trajektorienvorhersage leisten und

- interaktive, geschlossene Simulationen antreiben.

Aufbauend auf dieser Geschichte kündigte Huang Alpamayo an, ein offenes Portfolio aus Reasoning‑Vision‑Language‑Action‑Modellen, Simulations-Blueprints und Datensätzen, das den Weg zu einer level‑4‑fähigen Autonomie ebnet. Dazu gehören:

- Alpamayo R1 – das erste offene, rationale VLA-Modell für autonomes Fahren

- AlpaSim – ein vollständig offenes Simulationskonzept für hochpräzise AV-Tests

„Es verarbeitet nicht nur Sensordaten und steuert Lenkrad, Bremse und Beschleunigung, sondern begründet auch, welche Aktion es als Nächstes ausführt“, sagte Huang und leitete damit ein Video ein, das zeigt, wie ein Fahrzeug souverän durch den dichten Verkehr in San Francisco navigiert.

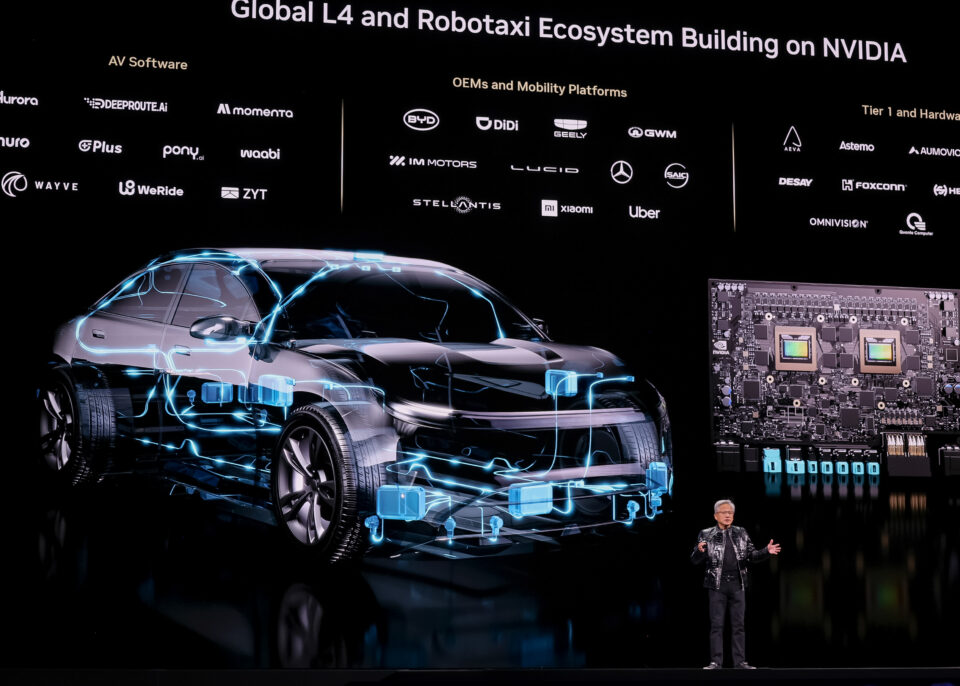

Huang kündigte außerdem an, dass das erste Serienfahrzeug mit Alpamayo auf der NVIDIA‑DRIVE‑Full-Stack-Plattform – der neue Mercedes‑Benz CLA – schon bald auf die Straße kommt, mit KI‑definiertem Fahren in den USA noch in diesem Jahr, nachdem der CLA kürzlich die Fünf‑Sterne‑Sicherheitswertung von EuroNCAP erhalten hat.

Zudem hob Huang die wachsende Dynamik hinter DRIVE Hyperion hervor, der offenen, modularen, level‑4‑fähigen Plattform, die von führenden Automobilherstellern, Zulieferern und Robotaxi‑Anbietern weltweit übernommen wird.

„Unsere Vision ist es, dass eines Tages jedes einzelne Auto und jeder LKW autonom sein wird – und wir arbeiten an dieser Zukunft“, sagte Huang.

Anschließend kamen zwei winzige piepsende, hüpfende Roboter auf die Bühne. Huang erklärte ihnen dabei, wie NVIDIAs Full-Stack-Ansatz ein globales physisches KI-Ökosystem vorantreibt.

Huang zeigte ein Video, wie Roboter in NVIDIA Isaac Sim und Isaac Lab in fotorealistischen simulierten Welten trainiert werden – bevor er die Arbeit von Partnern im Bereich physischer KI in der gesamten Branche hervorhob, darunter Synopsis und Cadence, Boston Dynamics und Franka sowie weitere.

Er kündigte zudem eine erweiterte Partnerschaft mit Siemens an, unterstützt durch eine Montage, die zeigt, wie sich NVIDIAs vollständiger Stack mit der industriellen Software von Siemens integrieren lässt und so physisches KI vom Design über Simulationen bis hin zur Produktion ermöglicht.

„Diese Fertigungsanlagen werden im Wesentlichen zu riesigen Robotern“, sagte Huang.

Zusammen die Zukunft gestalten

Huang erläuterte, dass NVIDIA heute komplette Systeme entwickelt, weil es einen vollständig optimierten Stack braucht, um KI‑Durchbrüche zu ermöglichen.

„Unsere Aufgabe ist es, den gesamten Stack zu schaffen, damit ihr alle unglaubliche Anwendungen für den Rest der Welt entwickeln könnt“, sagte er.

Sehen Sie sich die vollständige Präsentation erneut an:

DLSS 4.5 und weitere Gaming‑ und Creator‑Neuheiten

Am Montagabend kündigte NVIDIA DLSS 4.5 an, das Dynamic Multi Frame Generation, einen neuen 6X‑Multi‑Frame‑Generation‑Modus und ein zweites Transformer‑Modell für DLSS Super Resolution einführt, damit Spieler aktuelle Top‑Titel mit höherer Leistung und verbesserter Bildqualität erleben können.

Über 250 Spiele und Apps unterstützen inzwischen NVIDIA‑DLSS‑4‑Technologie, darunter die diesjährigen Blockbuster 007 First Light, Phantom Blade Zero, PRAGMATA und Resident Evil Requiem bereits zum Start.

Zudem startete RTX Remix Logic, das die Möglichkeiten der Remix‑Modding‑Plattform erweitert und Modder in die Lage versetzt, dynamische Grafikeffekte auf Basis von Echtzeit‑Spielereignissen zu triggern. NVIDIA ACE kam in Total War: PHARAOH als intelligenter KI‑Berater zum Einsatz, der Spielern hilft, die komplexen Spielsysteme zu durchdringen, während in PUBG: BATTLEGROUNDS der von NVIDIA ACE angetriebene PUBG Ally dank Langzeitgedächtnis immer schlauer und anpassungsfähiger wird.

Gleichzeitig kommen G‑SYNC‑Pulsar‑Monitore diese Woche auf den Markt, die ein ruckelfreies Bild mit einer wahrgenommenen Bewegungsschärfe von über 1.000 Hz und G‑SYNC Ambient Adaptive Technology bieten und damit einen neuen Goldstandard für Gamer setzen.

Darüber hinaus bringt NVIDIA GeForce‑RTX‑Gaming auf noch mehr Geräte – unter anderem mit neuen GeForce‑NOW‑Apps für Linux‑PCs und Amazon Fire TV – und beschleunigt die 4K‑KI‑Videogenerierung auf PCs mit Upgrades für LTX‑2 und ComfyUI.

Lesen Sie mehr über diese Ankündigungen vom Montagabend auf der CES in diesem Artikel zu den Neuigkeiten von GeForce.

Erfahren Sie mehr über alle Ankündigungen von NVIDIA auf der CES.