Anmerkung der Redaktion: Dieser Beitrag ist Teil der Nemotron Labs-Blogserie, die die sich damit beschäftigt, wie die neuesten offenen Modelle, Datensätze und Trainingstechniken Unternehmen dabei unterstützen, spezialisierte KI-Systeme und Anwendungen auf NVIDIA-Plattformen zu entwickeln. Jeder Beitrag beleuchtet praktische Möglichkeiten, wie sich ein Open-Stack-Ansatz in der Produktion als echter Mehrwert erweisen kann – von transparenten Forschungs-Copiloten bis hin zu skalierbaren KI-Agenten.

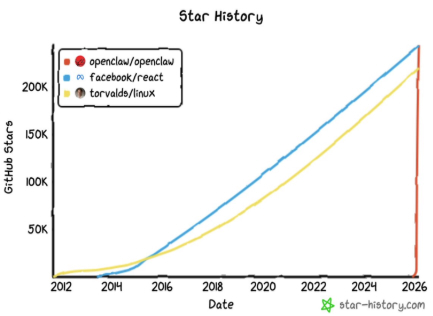

Anfang 2026 war das Open-Source-Projekt OpenClaw zu einem Phänomen geworden. Im Januar erreichte die GitHub-Sternezahl 100.000, als das Interesse der Entwickler stark anstieg. Community-Dashboards und Traffic-Analysen zeigten mehr als 2 Millionen Besucher in einer einzigen Woche. Bis März hatte OpenClaw 250.000 Sterne erreicht und React überholt, um in nur 60 Tagen das Softwareprojekt auf GitHub mit den meisten Sternen zu werden.

OpenClaw wurde von Peter Steinberger entwickelt und ist ein selbst gehosteter, persistenter KI-Assistent, der für die lokale Ausführung oder auf privaten Servern konzipiert wurde. Das Projekt zog durch seine Zugänglichkeit und unbegrenzte Autonomie Aufmerksamkeit auf sich: Benutzer konnten ein KI-Modell lokal bereitstellen, ohne von einer Cloud-Infrastruktur oder externen Anwendungsprogrammierschnittstellen (APIs) abhängig zu sein.

Die meisten KI-Agenten werden heute durch einen Prompt ausgelöst, erledigen eine definierte Aufgabe und hören dann auf zu laufen. Ein autonomer Agent mit langer Laufzeit oder „Claw“ funktioniert anders. Diese Agenten werden persistent im Hintergrund ausgeführt, erledigen Aufgaben selbst und zeigen nur das auf, was eine menschliche Entscheidung erfordert. Sie arbeiten wie ein Herzschlag: In regelmäßigen Abständen überprüfen sie ihre Aufgabenliste, bewerten, was getan werden muss, und handeln entweder oder warten auf den nächsten Zyklus.

Die schnelle Einführung von OpenClaw hat außerdem eine Debatte ausgelöst. Sicherheitsexperten haben Bedenken darüber geäußert, wie selbst gehostete KI-Tools sensible Daten, Authentifizierung und Modellaktualisierungen verwalten. Andere fragten, ob lokale Bereitstellungen Benutzer neuen Risiken aussetzen könnten – von ungepatchten Server-Instanzen bis hin zu böswilligen Beiträgen in Community-Forks. Als Mitwirkende und Betreuer daran arbeiteten, diese Probleme zu lösen, löste der Aufstieg von OpenClaw eine breitere Diskussion im gesamten KI-Ökosystem über die Kompromisse zwischen Offenheit, Datenschutz und Sicherheit aus.

Um die Sicherheit und Robustheit des OpenClaw-Projekts zu verbessern, arbeitet NVIDIA mit Steinberger und der OpenClaw-Entwickler-Community zusammen, um potenzielle Schwachstellen zu beheben, wie in einem kürzlich veröffentlichten Blog-Beitrag von OpenClaw beschrieben.

NVIDIA stellt Code und Anleitungen bereit, die sich auf die Verbesserung der Modellisolierung, die bessere Verwaltung des lokalen Datenzugriffs und die Stärkung der Prozesse für die Verifizierung von Community-Code-Beiträgen konzentrieren. Das Ziel ist es, die Dynamik des Projekts zu unterstützen, indem man sein Sicherheits- und System-Know-how auf offene, transparente Weise einbringt, die die Arbeit der Community stärkt und gleichzeitig die unabhängige Governance von OpenClaw bewahrt.

Um Agenten mit langer Laufzeit für Unternehmen sicherer zu machen, hat NVIDIA außerdem NVIDIA NemoClaw eingeführt, eine Referenzimplementierung, die einen einzigen Befehl zur Installation von OpenClaw, der sicheren NVIDIA OpenShell-Laufzeit und offenen NVIDIA Nemotron-Modellen mit gesicherten Standardeinstellungen für Netzwerke, Datenzugriff und Sicherheit verwendet. NemoClaw dient als Blueprint für Unternehmen, um Claws sicherer bereitzustellen.

Inferenzanforderungen vervielfachen sich mit jeder KI-Welle

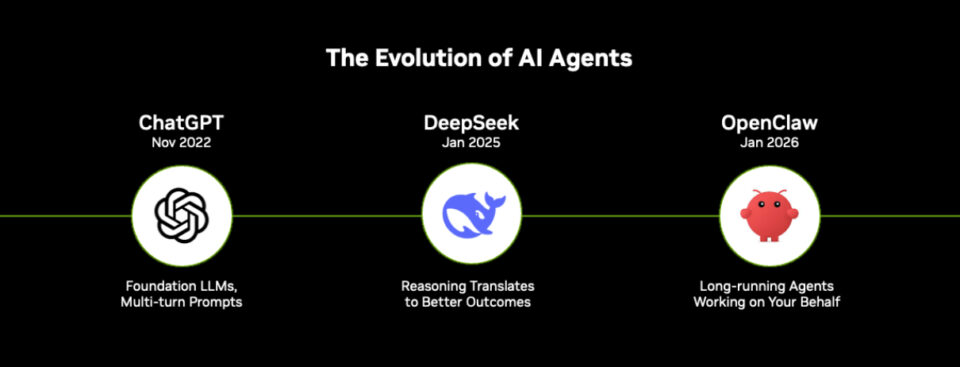

KI hat vier Phasen durchlaufen, und die Zeit zwischen den einzelnen Phasen wird immer kürzer. Predictive AI brauchte Jahre, um Mainstream zu werden. Generative KI entwickelte sich schneller. Reasoning-KI kam noch schneller. Autonome KI – die Welle von OpenClaw – legt ein noch schnelleres Tempo vor.

Was sich mit jeder Welle verstärkt, ist der Inferenzbedarf. Generative KI erhöhte die Token-Nutzung im Vergleich zu prädiktiver KI. Reasoning-KI hat diese Zahl noch einmal um das 100-Fache gesteigert. Autonome Agenten, die kontinuierlich ausgeführt werden und über lange Zeithorizonte hinweg agieren, steigern die Inferenznachfrage um das weitere 1.000-Fache im Vergleich zur Reasoning-KI. Jede Welle vervielfacht die erforderliche Rechenleistung.

Dieser Anstieg der Token-Nutzung ermöglicht es Unternehmen, ihre Produktivität um Größenordnungen zu steigern. Beispielsweise können Agenten mit langer Laufzeit Forschern helfen, ein Problem über Nacht zu lösen, ein Design in Tausenden von Konfigurationen iterativ anzupassen oder Systeme zu überwachen und nur die Anomalien aufzudecken, die menschliches Urteilsvermögen erfordern – wodurch die Arbeitstage der Forscher für höherwertige Aufgaben frei bleiben.

Auswahl des Tools: Wann sollte man eine „Claw“ bereitgestellen.

Während generative KI zu einem festen Bestandteil für On-Demand-Aufgaben geworden ist, gibt es bestimmte Szenarien, in denen der anhaltende „Herzschlag“ einer Claw deutliche Vorteile bietet. Die Entscheidung, wann von einer standardmäßigen Prompt-basierten KI zu einem Agenten mit langer Laufzeit übergegangen werden soll, hängt häufig von der Art des Workflows ab:

- Von „On-Demand“ bis „Always-On“: Während Standardmodelle hervorragend für sofortige, von Menschen ausgelöste Abfragen sind, sind Claws häufig besser für Aufgaben geeignet, die eine kontinuierliche Hintergrundüberwachung oder periodische Systemprüfungen ohne manuellen Start erfordern.

- Verwaltung von Schleifen mit hoher Iteration: Bei komplexen Problemen wie dem Testen von Tausenden von chemischen Kombinationen oder der Simulation von Infrastruktur-Stresstests kann ein Claw die schiere Menge an Iterationen bewältigen, die sonst durch menschliches Eingreifen zu einem Engpass werden könnten.

- Übergang von Vorschlägen zu Handlungen: In vielen Workflows wird Standard-KI verwendet, um Informationen oder Entwürfe bereitzustellen. Eine Claw wird häufig in Betracht gezogen, wenn das Ziel darin besteht, dass die KI in die Ausführungsphase übergeht – durch Interaktion mit APIs, Aktualisierung von Datenbanken oder Verwaltung von Dateien über einen langen Zeithorizont hinweg.

- Ressourcenoptimierung: Für umfangreiche, tokenintensive Reasoning-Aufgaben ermöglicht die Bereitstellung eines lokalen Claw auf dedizierter Hardware wie einem persönlichen NVIDIA DGX Spark KI-Supercomputer vorhersehbarere Kosten und Datenschutz im Vergleich zu hochfrequenten Cloud-API-Aufrufen.

Wie nutzen Unternehmen autonome Agenten mit langer Laufzeit?

Die praktischen Anwendungen von autonomen Agenten mit langer Laufzeit umfassen alle Funktionen und Bereiche.

Im Bereich Finanzdienstleistungen überwachen Agenten kontinuierlich Handelssysteme und regulatorische Feeds und melden wichtige Ereignisse vor der morgendlichen Überprüfung. In der Medikamentenentwicklung durchsuchen Agenten neue wissenschaftliche Literatur, extrahieren relevante Ergebnisse und aktualisieren interne Datenbanken in Echtzeit, ohne dass Forscher eingreifen müssen – ein Prozess, der zuvor Wochen dauerte.

In den Bereichen Technik und Fertigung beschleunigen Agenten die Problemanalyse, indem sie Tausende von Parameterkombinationen testen, die Ergebnisse einstufen und die Konfigurationen kennzeichnen, die es wert sind, überprüft zu werden – und all dies kann über Nacht geschehen.

Im IT-Betrieb diagnostizieren Agenten Infrastruktur-Vorfälle, wenden bekannte Korrekturen an und eskalieren nur die neuen Probleme, wobei die durchschnittliche Zeit bis zur Auflösung von Stunden auf Minuten verkürzt wird. Bei ServiceNow können KI-Spezialisten, die Apriel- und NVIDIA Nemotron-Modelle nutzen, 90 % der Tickets autonom lösen.

Wie können Unternehmen autonome Agenten verantwortungsvoll bereitstellen?

Autonome Agenten sind praxisnah. Sie können Nachrichten versenden, Dateien schreiben, APIs aufrufen und Live-Systeme aktualisieren. Wenn ein Agent eine falsche Handlung ausführt, gibt es reale Konsequenzen. Es ist unerlässlich, das Verantwortlichkeits-Framework von Anfang an richtig zu gestalten, und Unternehmen, die autonome Agenten in der Produktion einsetzen, müssen Governance als eine Anforderung erster Ordnung behandeln.

Unternehmen müssen sehen, was ihre Agenten tun, ihr logisches Denken in jedem Schritt prüfen, ihre Handlungen auditieren und bei Bedarf eingreifen.

Unternehmen, die autonome Agenten verantwortungsvoll einsetzen, konzentrieren sich auf drei Prioritäten:

- Ein offenes, prüfbares Framework: NemoClaw basiert auf der MIT-lizenzierten Codebasis von OpenClaw, was bedeutet, dass Unternehmen das vollständige Agenten-Harness besitzen. Sie können jede Ebene der Art und Weise, wie ihre Agenten entwickelt und bereitgestellt werden, einsehen, verzweigen und anpassen. Diese Transparenz ermöglicht es Teams, das System auf Code-Ebene zu verstehen und zu steuern. Durch die lokale Ausführung von Open-Source-Modellen wie NVIDIA Nemotron werden sensible Workloads, einschließlich Patientenakten, juristische Dokumente, Finanztransaktionen und proprietäre Forschungsergebnisse, in der unternehmenseigenen Umgebung gespeichert, sodass Trace-Daten unter der unternehmenseigenen Kontrolle bleiben.

- Sicherung der Laufzeitumgebung: NemoClaw führt Agenten innerhalb von OpenShell aus, einer Sandbox-Umgebung, in der genau definiert ist, was der Agent tun kann und was nicht, und von Anfang an klare Berechtigungsgrenzen durchgesetzt werden.

- Lokale Rechenleistung: NVIDIA DGX Spark KI-Supercomputer bieten GPU-Leistung der Rechenzentrumsklasse in einem Deskside-Formfaktor, der für kontinuierliche lokale Inferenz entwickelt wurde, die immer eingeschaltet ist, mit lokalem Modell-Hosting und Daten, die innerhalb der Unternehmensumgebung bleiben. NVIDIA DGX Station-Systeme skalieren diese Fähigkeit für Teams, die mehrere Agenten gleichzeitig in komplexen, dauerhaften Workloads ausführen.

Die Organisationen, die festlegen, was autonome Agenten in der Praxis leisten, sammeln wertvolle Erkenntnisse: monatelange Erfahrungen aus dem realen Betrieb, Governance-Rahmenwerke, die anhand realer Arbeitslasten entwickelt wurden, sowie Agenten, die den institutionellen Kontext verinnerlicht haben, der sie wirklich nützlich macht. Diese Grundlage wird sich im Laufe der Zeit nur vertiefen.

Erste Schritte mit NVIDIA NemoClaw

Greifen Sie auf ein Schritt-für-Schritt-Tutorial zu, wie Sie einen sichereren KI-Agenten mit NemoClaw auf NVIDIA DGX Spark entwickeln. Erfahren Sie, wie NemoClaw sicherere, Always-on-KI-Assistenten mit einem einzigen Befehl bereitstellen kann.

Experimentieren Sie mit NemoClaw, das auf GitHub verfügbar ist, und treten Sie der Community von Entwicklern auf Discord bei, die mit NemoClaw unter Verwendung von NVIDIA Nemotron 3 Super und Telegram auf DGX Spark entwickeln.

Bleiben Sie über agentische KI, NVIDIA Nemotron und mehr auf dem Laufenden, indem Sie NVIDIA KI-Neuigkeiten abonnieren, der Community beitreten und NVIDIA AI auf LinkedIn, Instagram, X und Facebook folgen.

Erkunden Sie Video-Tutorials und Livestreams im eigenen Tempo.