Herkömmliche Rechenzentren dienten lediglich der Speicherung, dem Abruf und der Verarbeitung von Daten. In der Ära der generativen und agentischen KI haben sich diese Einrichtungen zu KI-Token-Fabriken entwickelt. Da KI-Inferenz zu ihrem wichtigsten Workload wird, ist ihr wichtigster Output die hergestellte Intelligenz in Form von Token.

Diese Transformation erfordert eine entsprechende Änderung der Art und Weise, wie die Wirtschaftlichkeit der KI-Infrastruktur, einschließlich der Gesamtbetriebskosten (TCO), bewertet wird. Unternehmen, die ihre KI-Infrastruktur evaluieren, konzentrieren sich nach wie vor allzu oft auf die Spitzenwerte der Chipspezifikationen, Rechenkosten oder Gleitkommaoperationen pro Sekunde für jeden ausgegebenen Dollar, d. h. FLOPS pro Dollar.

Der entscheidende Unterschied ist:

- Die Rechenkosten sind das, was Unternehmen für ihre KI-Infrastruktur zahlen, unabhängig davon, ob sie von Cloud-Anbietern gemietet oder vor Ort betrieben wird.

- FLOPS pro Dollar gibt an, wie viel Rechenleistung ein Unternehmen für jeden ausgegebenen Dollar erhält. Rohe Rechenleistung und reale Token-Ausgabe sind jedoch nicht dasselbe.

- Die Kosten pro Token sind die Gesamtkosten eines Unternehmens für die Produktion jedes gelieferten Tokens, die in der Regel als Kosten pro Million Token dargestellt werden.

Die ersten beiden sind lediglich Eingabemetriken. Die Optimierung von Inputs, während das Unternehmen auf der Basis des Outputs arbeitet, ist ein grundlegendes Missverhältnis.

Die Kosten pro Token bestimmen, ob Unternehmen KI profitabel skalieren können. Es ist die einzige TCO-Metrik, die direkt die Hardware-Leistung, die Software-Optimierung, den Ökosystem-Support und die reale Auslastung berücksichtigt – und NVIDIA bietet die branchenweit niedrigsten Kosten pro Token.

Welche Faktoren senken die Token-Kosten?

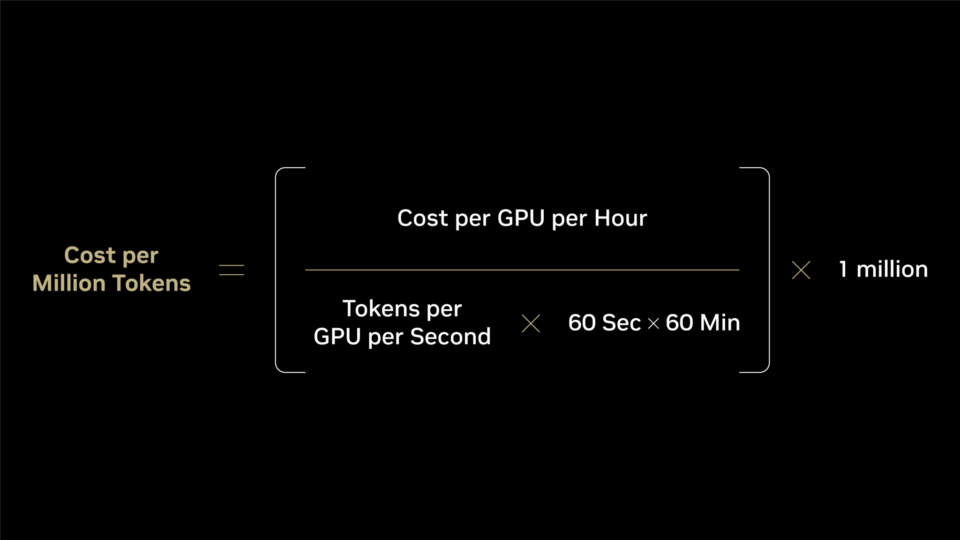

Um zu verstehen, wie die Token-Kosten optimiert werden können, muss man sich die Gleichung für die Berechnung der Kosten pro Million Token ansehen.

Bei dieser Gleichung konzentrieren sich viele Unternehmen, die KI-Infrastrukturen bewerten, auf den Zähler: die Kosten pro GPU und Stunde. Bei Cloud-Bereitstellungen ist dies der an einen Cloud-Anbieter gezahlte Stundensatz, bei lokalen Bereitstellungen sind es die effektiven Stundensätze, die sich aus der Amortisation der eigenen Infrastruktur ergeben. Der eigentliche Schlüssel zur Senkung der Token-Kosten liegt jedoch im Nenner: der Maximierung der gelieferten Token-Ausgabe.

Dieser Nenner hat zwei geschäftliche Implikationen.

- Minimierung der Token-Kosten: Wenn sich dieser Anstieg der Token-Ausgabe in der Kostengleichung widerspiegelt, sinken die Kosten pro Token, und dies erhöht die Gewinnmarge bei jeder durchgeführten Interaktion.

- Umsatz maximieren: Mehr pro Sekunde gelieferte Token führen auch zu mehr Token pro Megawatt, was bedeutet, dass mehr Intelligenz in KI-gestützten Produkten und Dienstleistungen eingesetzt werden kann, wodurch mit derselben Infrastrukturinvestition mehr Umsatz generiert wird.

Sich nur auf den Zähler zu konzentrieren, bedeutet also zu übersehen, was den Nenner antreibt. Stellen Sie es sich als einen „Inferenz-Eisberg“ vor: Der Zähler befindet sich oberhalb der Oberfläche, ist sichtbar und leicht zu vergleichen. Der Nenner ist alles, was sich unter der Oberfläche befindet und wichtige Faktoren darstellt, die die reale Token-Ausgabe bestimmen. Die genaue Bewertung der KI-Infrastruktur beginnt mit der Frage, was darunter liegt.

- Anfragen für die Oberflächenebene:

- Wie hoch sind die Kosten pro GPU-Stunde?

- Wie hoch sind die Spitzen-Petaflops und die Kapazität des Speichers mit hoher Bandbreite?

- Wie hoch sind die FLOPS pro Dollar?

- Umfassende Kostenanalyse:

- Wie hoch sind die Kosten pro Million Token? Wie hoch sind insbesondere die Kosten pro Million Token für umfangreiche Mixture-of-Experts-Reasoning-Modelle (MoE), die die am häufigsten verwendete Art von KI-Modellen darstellen?

- Wie hoch ist die bereitgestellte Token-Ausgabe pro Megawatt? Insbesondere bei lokalen Bereitstellungen, bei denen der Kapitalbedarf für Grundstücke, Energie und Infrastruktur hoch ist, ist die Maximierung der pro Megawatt erzeugten Intelligenz entscheidend.

- Kann die Scale-up-Verbindung den „All-to-All“-Verkehr von MoE-Modellen bewältigen?

- Wird FP4-Genauigkeit unterstützt? Kann der Inferenz-Stack FP4 nutzen und gleichzeitig eine hohe Genauigkeit beibehalten?

- Unterstützt die Inferenz-Laufzeit spekulative Decodierung oder Multi-Token-Vorhersage, um die Benutzerinteraktivität zu erhöhen?

- Unterstützt die Serving-Ebene disaggregiertes Bereitstellen, KV-bewusstes Routing, KV-Cache-Offloading und andere Optimierungen?

- Unterstützt die Plattform die einzigartigen Workload-Anforderungen der agentischen KI – einschließlich extrem niedriger Latenz, hohem Durchsatz und großer Eingabesequenzen?

- Unterstützt die Plattform den gesamten Lebenszyklus, vom Training und Nachtrainieren bis hin zur umfangreichen Inferenz, über alle Modellarchitekturen hinweg, um die Austauschbarkeit der Infrastruktur und eine hohe Auslastung zu gewährleisten?

Jede dieser algorithmischen, Hardware- und Software-Optimierungen muss aktiv und integriert sein, da sonst der Nenner in sich zusammenbricht. Eine „billigere“ GPU, die deutlich weniger Token pro Sekunde liefert, führt zu deutlich höheren Kosten pro Token. Eine KI-Infrastruktur, die im gesamten Stack alles richtig macht, stellt sicher, dass jede Optimierung die anderen verbessert.

Warum sind die Kosten pro Token viel wichtiger als FLOPS pro Dollar?

Die folgenden Daten für das DeepSeek-R1 KI-Modell zeigen den Unterschied zwischen theoretischen und tatsächlichen Geschäftsergebnissen.

Betrachtet man allein die Rechenkosten, scheint die NVIDIA Blackwell-Plattform etwa doppelt so viel zu kosten wie NVIDIA Hopper – die Rechenkosten sagen jedoch nichts über die Leistung aus, die mit der Investition erzielt werden kann. Eine Analyse von bloßen FLOPS pro Dollar zeigt einen doppelten NVIDIA Blackwell-Vorteil im Vergleich zur NVIDIA Hopper-Architektur. Das tatsächliche Ergebnis ist jedoch erheblich anders: Blackwell bietet eine mehr als 50-mal höhere Token-Ausgabe pro Watt als Hopper, was zu fast 35-mal geringeren Kosten pro Million Token führt.

| Metrik |

NVIDIA Hopper (HGX H200) |

NVIDIA Blackwell (GB300 NVL72) |

NVIDIA Blackwell im Vergleich zu Hopper |

| Kosten pro GPU pro Stunde ($) | $1,41 | $2,65 | 2-mal |

| FLOP pro Dollar (PFLOPS) | 2,8 | 5,6 | 2-mal |

| Token pro Sekunde pro GPU | 90 | 6.000 | 65x |

| Token pro Sekunde pro MW | 54K | 2,8 Mio. | 50x |

| Kosten pro Million Token ($) | $4,20 | $0,12 | 35-mal niedriger |

Hinweis: Die Daten stammen aus der NVIDIA-Analyse und dem SemiAnalysis InferenceX v2 Benchmark.

Diese erhebliche Divergenz zeigt, dass NVIDIA Blackwell gegenüber der früheren Hopper-Generation einen erheblichen Sprung beim Geschäftswert bietet, der jegliche Zunahme der Systemkosten bei weitem übertrifft.

So wählen Sie die richtige KI-Infrastruktur aus

Der Vergleich von KI-Infrastrukturen auf der Grundlage von Rechenkosten oder theoretischen FLOPS pro Dollar ist nicht nur unzureichend, sondern liefert auch keine genaue Darstellung der Inferenzökonomie. Wie die Daten zeigen, erfordert eine genaue Bewertung des Umsatzpotenzials und der Rentabilität der KI-Infrastruktur einen Wechsel von Eingabemesswerten zu Kosten pro Token und geliefertem Token-Output.

NVIDIA bietet die branchenweit niedrigsten Token-Kosten und den höchsten Token-Durchsatz durch extremes Co-Design in den Bereichen Rechenleistung, Netzwerke, Speicher, Datenspeicher, Software und Partnertechnologien. Darüber hinaus bedeutet die ständige Optimierung von Open-Source-Inferenzsoftware wie vLLM, SGLang, NVIDIA TensorRT-LLM und NVIDIA Dynamo auf der NVIDIA-Plattform, dass die Token-Ausgabe auf der bestehenden NVIDIA-Infrastruktur weiter steigt und die Kosten pro Token auch nach ihrem Erwerb weiter sinken.

Führende Cloud-Anbieter und NVIDIA Cloud-Partner bieten diesen Vorteil bereits in großem Maßstab an. Partner wie CoreWeave, Nebius, Nscale und Together AI haben die NVIDIA Blackwell-Infrastruktur bereitgestellt und ihre Stacks optimiert, um Unternehmen die derzeit niedrigsten Token-Kosten zu bieten, wobei jede bereitgestellte Interaktion in vollem Umfang von der gemeinsamen Entwicklung von Hardware, Software und Ökosystem durch NVIDIA profitiert.