Nachrichtenzusammenfassung:

Die NVIDIA Vera Rubin-Plattform erweitert die Grenzen der KI mit:

- Vera Rubin NVL72-GPU-Racks

- Vera CPU-Racks

- NVIDIA Groq 3 LPX-Inferenz-Beschleuniger-Racks

- NVIDIA BlueField-4 STX-Datenspeicher-Racks

- NVIDIA Spectrum-6 SPX Ethernet-Racks

GTC—NVIDIA hat heute bekannt gegeben, dass die NVIDIA Vera Rubin-Plattform die nächste Dimension der agentischen KI erschließt. Sieben neue Chips sind jetzt in voller Produktion, um die weltweit größten KI-Fabriken auszubauen.

Die Plattform vereint die NVIDIA Vera CPU, die NVIDIA Rubin-GPU, den NVIDIA NVLink-6 Switch, den NVIDIA ConnectX-9 SuperNIC, die NVIDIA BlueField-4 DPU und den NVIDIA Spectrum-6 Ethernet-Switch sowie die neu integrierte NVIDIA Groq 3 LPU. Die Chips sind darauf ausgelegt, gemeinsam als ein einziger, leistungsstarker KI-Supercomputer zu fungieren, und unterstützen alle Phasen der KI – vom Vor- und Nachtraining in großem Maßstab über die Skalierung in der Testphase bis hin zur agentischen Inferenz in Echtzeit.

„Vera Rubin ist ein Generationssprung – sieben bahnbrechende Chips, fünf Racks, ein riesiger Supercomputer – der entwickelt wurde, um jede Phase der KI zu unterstützen“, erklärt Jensen Huang, Gründer und CEO von NVIDIA. „Der Wendepunkt für agentische KI ist da: Vera Rubin hat den größten Infrastrukturausbau in der Geschichte eingeleitet.“

„Unternehmen und Entwickler nutzen Claude für immer komplexere Schlussfolgerungen, agentische Workflows und geschäftskritische Entscheidungen. Das erfordert eine Infrastruktur, die mit dem Tempo Schritt halten kann“, erklärt Dario Amodei, CEO und Mitbegründer von Anthropic. „Die Vera-Rubin-Plattform von NVIDIA bietet uns die Rechenleistung, Netzwerke und das Systemdesign, um weiterhin unsere Leistungsversprechungen zu erfüllen und gleichzeitig die Sicherheit und Zuverlässigkeit zu verbessern, auf die sich unsere Kunden verlassen.”

„Die NVIDIA-Infrastruktur ist die Grundlage, die es uns ermöglicht, die Grenzen der KI weiter zu verschieben“, erklärt Sam Altman, CEO von OpenAI. „Mit NVIDIA Vera Rubin werden wir leistungsstärkere Modelle und Agenten in großem Maßstab ausführen und Hunderten Millionen von Menschen schnellere, zuverlässigere Systeme bereitstellen.“

Übergang zu POD-Scale-Systemen

Die KI-Infrastruktur entwickelt sich rasant – von diskreten Chips und eigenständigen Servern bis hin zu vollständig integrierten Rack-Scale-Systemen, POD-Scale-Bereitstellungen, KI-Fabriken und souveräner KI. Diese Fortschritte führen zu erheblichen Leistungssteigerungen, verbessern die Kosteneffizienz von Unternehmen jeder Größe und Branchen – von Startups und mittelständischen Unternehmen bis hin zu öffentlich-privaten Institutionen und Unternehmen – während sie gleichzeitig dazu beitragen, den Zugang zu KI zu demokratisieren und die Energieeffizienz zu verbessern, um die weltweit anspruchsvollsten Workloads zu unterstützen.

Durch eine umfassende gemeinsame Entwicklung in den Bereichen Rechenleistung, Netzwerke und Datenspeicher, unterstützt von einem Ökosystem aus mehr als 80 NVIDIA MGX-Ökosystempartnern mit einer globalen Lieferkette, bietet NVIDIA Vera Rubin die umfangreichste Plattform im NVIDIA POD-Maßstab – ein Supercomputer, in dem mehrere Racks, die speziell für KI entwickelt wurden, als ein massives, kohärentes System zusammenarbeiten.

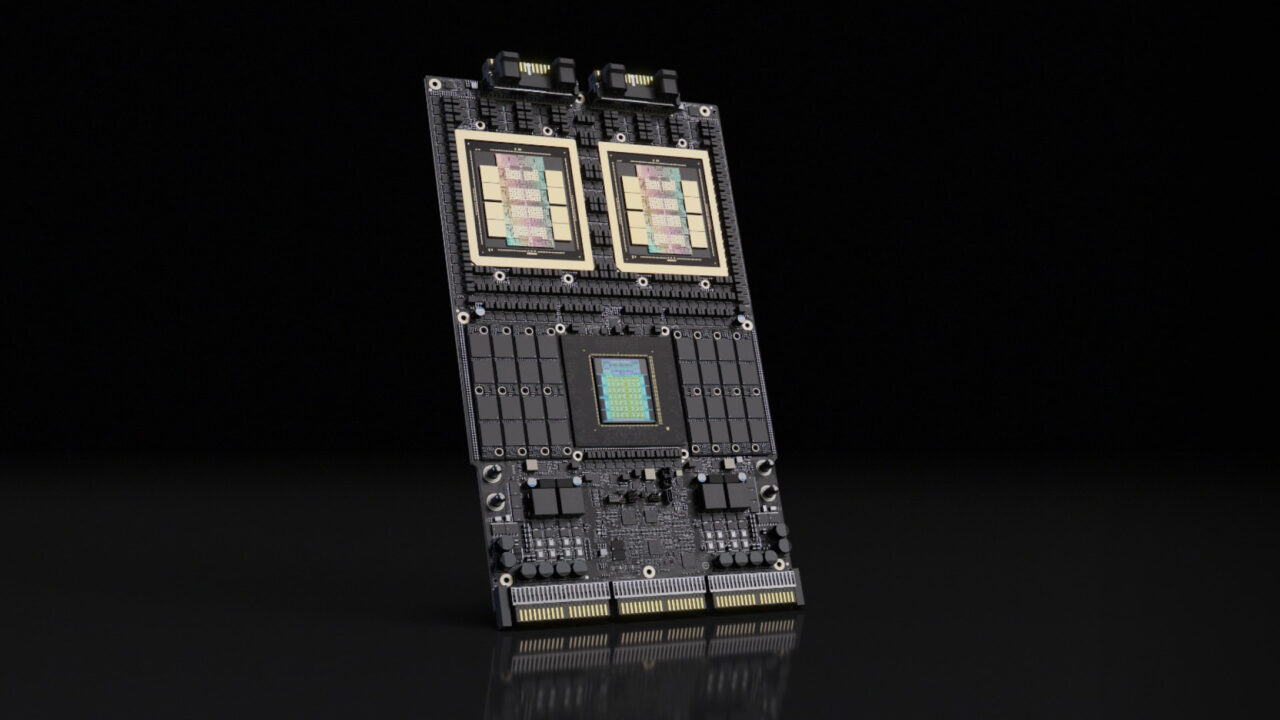

NVIDIA Vera Rubin NVL72 Rack

Durch die Integration von 72 Rubin-GPUs und 36 Vera-CPUs, die über NVLink 6 verbunden sind, sowie ConnectX-9 SuperNICs und BlueField-4 DPUs bietet Vera Rubin NVL72 bahnbrechende Effizienz – es trainiert große Mixture-of-Experts-Modelle mit einem Viertel der GPUs im Vergleich zur NVIDIA Blackwell-Plattform und erzielt einen bis zu 10-mal höheren Inferenzdurchsatz pro Watt bei einem Zehntel der Kosten pro Token.

NVL72 wurde für Hyperscale-KI-Fabriken weltweit entwickelt und skaliert nahtlos mit NVIDIA Quantum-X800 InfiniBand und Spectrum-X Ethernet, um eine hohe Auslastung in massiven GPU-Clustern aufrechtzuerhalten und gleichzeitig die Zeit des Training und die Gesamtbetriebskosten zu reduzieren.

NVIDIA Vera CPU Rack

Bestärkendes Lernen und agentische KI-Workloads basieren auf einer großen Anzahl von CPU-basierten Umgebungen, um die Ergebnisse zu testen und zu validieren, die von Modellen generiert werden, die auf GPU-Systemen ausgeführt werden.

Das NVIDIA Vera CPU Rack bietet eine dichte, flüssigkeitsgekühlte Infrastruktur, die auf NVIDIA MGX basiert und 256 Vera-CPUs integriert, um skalierbare, energieeffiziente Kapazität mit erstklassiger Single-Thread-Leistung zu bieten und agentische KI in großem Maßstab zu ermöglichen.

Vera CPU-Racks sind in Spectrum-X Ethernet-Netzwerke integriert und halten die CPU-Umgebungen in der gesamten KI-Fabrik eng synchronisiert. Zusammen mit GPU-Rechen-Racks bieten sie die CPU-Grundlage für agentische KI und bestärkendes Lernen in großem Maßstab — wobei Vera Ergebnisse doppelt so effizient und 50 % schneller als herkömmliche CPUs liefert.

NVIDIA Groq 3 LPX Rack

NVIDIA Groq 3 LPX markiert einen Meilenstein im Bereich beschleunigtes Computing. LPX und Vera Rubin wurden für die Anforderungen agentischer Systeme an eine geringe Latenz und große Kontexte entwickelt und vereinen die extreme Leistung beider Prozessoren, um einen bis zu 35-mal höheren Inferenzdurchsatz pro Megawatt und bis zu 10-mal höhere Umsatzchancen für Modelle mit Billionen Parametern zu ermöglichen.

In großem Maßstab fungiert eine Flotte von LPUs als riesiger einzelner Prozessor für schnelle, deterministische Inferenzbeschleunigung. Das LPX-Rack mit 256 LPU-Prozessoren verfügt über 128 GB On-Chip-SRAM und 640 TB/s Scale-up-Bandbreite. In Verbindung mit Vera Rubin NVL72 beschleunigen Rubin-GPUs und LPUs die Dekodierung, indem sie gemeinsam jede Schicht des KI-Modells für jedes Ausgabetoken berechnen.

Die gemeinsam entwickelte LPX-Architektur wurde für Modelle mit Billionen Parametern und einem Kontext mit Millionen Token optimiert und wird mit Vera Rubin kombiniert, um die Effizienz in den Bereichen Energie, Speicher und Rechenleistung zu maximieren. Der zusätzliche Durchsatz pro Watt und die Token-Leistung eröffnen eine neue Dimension der Ultra-Premium-Inferenz mit Billionen Parametern und Millionen von Kontexten und erweitern die Umsatzchancen für alle KI-Anbieter. LPX ist vollständig flüssigkeitsgekühlt und basiert auf einer MGX-Infrastruktur. Es lässt sich nahtlos in Vera-Rubin-KI-Fabriken der nächsten Generation integrieren, die in der zweiten Hälfte dieses Jahres verfügbar sein werden.

NVIDIA BlueField-4 STX Datenspeicher Rack

Das NVIDIA BlueField-4 STX-Rack-Scale-System ist eine KI-native Datenspeicherinfrastruktur, die GPU-Speicher nahtlos über den POD hinweg erweitert. Basierend auf BlueField-4 – das die NVIDIA Vera-CPU und das NVIDIA ConnectX-9 SuperNIC verbindet – bietet STX eine gemeinsame Schicht mit hoher Bandbreite, die für die Speicherung und den Abruf der riesigen Mengen an Schlüssel-Wert-Cache-Daten optimiert ist, die von großen Sprachmodellen und agentenbasierten KI-Workflows erzeugt werden.

NVIDIA DOCA Memos™ – ein neuer DOCA-Framework, der BlueField-4-Speicher beschleunigt – ermöglicht die Verarbeitung dedizierter KV-Cache-Datenspeicher, um den Inferenzdurchsatz um das bis zu Fünffache zu steigern und gleichzeitig die Energieeffizienz im Vergleich zu allgemeinen Speicherarchitekturen erheblich zu verbessern. Das Ergebnis ist ein POD-weiter Kontext, der schnellere Multi-Turn-Interaktionen mit KI-Agenten, skalierbaren KI-Diensten und eine höhere Auslastung der gesamten Infrastruktur ermöglicht.

„Das NVIDIA BlueField-4 STX-Kontext-Datenspeichersystem im Rack-Scale wird einen entscheidenden Leistungsschub ermöglichen, der für die exponentielle Skalierung unserer Bemühungen um agentische KI erforderlich ist“, erklärt Timothée Lacroix, Mitbegründer und Chief Technology Officer von Mistral AI. „Durch die Bereitstellung einer neuen Datenspeicherebene, die speziell für den Speicher von KI-Agenten entwickelt wurde, ist STX bestens aufgestellt, um sicherzustellen, dass unsere Modelle beim Schlussfolgern aus riesigen Datensätzen Kohärenz und Geschwindigkeit beibehalten können.“

NVIDIA Spectrum-6 SPX Ethernet Rack

Spectrum-6 SPX Ethernet wurde entwickelt, um den Ost-West-Verkehr in KI-Fabriken zu beschleunigen. Es kann entweder mit Spectrum-X Ethernet- oder NVIDIA Quantum-X800 InfiniBand-Switches konfiguriert werden und bietet Rack-to-Rack-Konnektivität mit geringer Latenz und hohem Durchsatz in großem Maßstab.

Spectrum-X Ethernet-Photonics mit Co-Packaged-Optik erzielt eine bis zu 5-mal höhere optische Energieeffizienz und eine 10-mal höhere Ausfallsicherheit im Vergleich zu herkömmlichen steckbaren Transceivern.

Verbesserung von Ausfallsicherheit und Energieeffizienz

NVIDIA hat zusammen mit über 200 Partnern für Rechenzentrumsinfrastruktur DSX für die Vera Rubin-Plattform angekündigt. Die neue DSX-Plattform umfasst DSX Max-Q, um eine dynamische Energieversorgung in der gesamten KI-Fabrik zu ermöglichen, was zur Bereitstellung von 30 % mehr KI-Infrastruktur innerhalb eines Rechenzentrums mit fester Energieversorgung führt. Die neue DSX Flex-Software ermöglicht es KI-Fabriken, als netzflexible Anlagen zu fungieren und so 100 Gigawatt an sonst ungenutztem Netzstrom nutzbar zu machen.

NVIDIA hat heute außerdem das Vera Rubin DSX KI-Fabrik-Referenzdesign veröffentlicht, einen Blueprint für eine gemeinsam entwickelte KI-Infrastruktur, die die Token pro Watt und den Gesamtdurchsatz maximiert, wobei die Ausfallsicherheit der Systeme verbessert und die Zeit bis zur ersten Produktion verkürzt wird.

Durch die enge Integration von Rechenleistung, Netzwerken, Datenspeicher, Energie und Kühlung erhöht die Architektur die Energieeffizienz und stellt sicher, dass KI-Fabriken bei kontinuierlichen, hochintensiven Workloads mit maximaler Verfügbarkeit zuverlässig skaliert werden können.

Umfassende Unterstützung des Ökosystems

Vera-Rubin-basierte Produkte werden ab der zweiten Hälfte dieses Jahres bei Partnern erhältlich sein. Dazu gehören die führenden Cloud-Anbieter Amazon Web Services, Google Cloud, Microsoft Azure und Oracle Cloud Infrastructure sowie die NVIDIA Cloud-Partner CoreWeave, Crusoe, Lambda, Nebius, Nscale und Together AI.

Die globalen Systemhersteller Cisco, Dell Technologies, HPE, Lenovo und Supermicro werden voraussichtlich eine Vielzahl von Servern liefern, die auf Vera-Rubin-Produkten basieren, ebenso wie Aivres, ASUS, Foxconn, GIGABYTE, Inventec, Pegatron, Quanta Cloud Technology (QCT), Wistron und Wiwynn.

KI-Labore und Entwickler von Frontier-Modellen wie Anthropic, Meta, Mistral AI und OpenAI beabsichtigen die NVIDIA Vera Rubin-Plattform zu nutzen, um größere, leistungsfähigere Modelle zu trainieren und multimodale Systeme mit langem Kontext zu einer geringeren Latenz und geringeren Kosten als mit früheren GPU-Generationen bereitzustellen.